Der Autofahrer sollte stets Herr seiner Sinne sein und während der Fahrt mit beiden Augen auf die Straße schauen. Damit ist es in Zukunft längst nicht getan, denn für das hoch automatisierte Fahren, kommen deutlich mehr Augen ins Spiel.

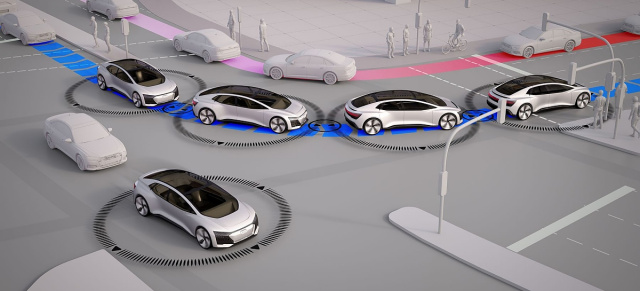

Wer sich den neuen Lotus Eletre oder einen Nio ET5 anschaut, dem werden die zusätzlichen Linsen auffallen, die sich oberhalb der Windschutzscheibe befinden. Andere Modelle haben seit Jahren an Front, Heck und Flanken weitere Kameraaugen und das sind nur jene Sensoren, die man von außen erkennen kann. Bei den modernen Fahrerassistenzsystemen geht ohne eine Vielzahl elektronischer Augen gar nichts. Lidar, Radar, Kameras und weitere Sensoren sorgen dafür, dass das Auto sicher durch den Verkehr kommt, überholen oder überholen kann und im Notfall sogar sicher abbremst. Einige Autohersteller hatten mit der sogenannten Fahrerassistenzstufe drei schon vor mehreren Jahren das hoch automatisierte Fahren versprochen. Geblieben ist davon bisher nicht viel. Tesla musste seinen Autopiloten mehrfach zurückschrauben und Mercedes lässt seine S-Klasse bei einem Stau bis maximal Tempo 60 nur dann eigenmächtig das Steuer übernehmen, wenn es sich um eine Schnellstraße mit getrennten Fahrspuren handelt – wohlgemerkt ausschließlich in Deutschland. Es hakt beim hoch automatisierten und noch mehr beim autonomen Fahren.

Mercedes stellte gerade erst seine neue E-Klasse vor, BMW das Doppelpack auf 5er und 7er, während Nio in kurzer Zeit mit dem ET5 erstmals eine elektrische Mittelklasselimousine anbietet. Was allen Modellen aktuell fehlt, ist die von vielen Autofahrern sehnlichst erwartete Fahrerassistenzstufe drei, bei der das Auto erstmals die Verantwortung übernimmt und der Fahrer entspannt lesen oder seine Mails checken kann. Es scheint beinahe wie eine unendliche Geschichte, die sich zieht wie alter Kaugummi. Beim Level 2 vollzieht das Fahrzeug unter klar definierten Bedingungen teilautonome Manöver, hält die Spur, bremst und beschleunigt, aber der Fahrer behält das Kommando und muss jederzeit eingreifen. Schließlich haftet er auch für etwaige Schäden. Eine ganz andere Hausnummer ist dagegen die nächste Stufe des autonomen Fahrens. Beim Level 3 agiert das Fahrzeug selbstständig und der Fahrzeughersteller steht in der Haftung, falls es zu einem Umfall kommt. Der Mensch darf sich während der Fahrt um E-Mails kümmern, Videos schauen und muss den Verkehr nicht ständig im Blick haben. Problem: die neuen Autos bieten das alle nicht.

Bereits vor fünf Jahren hatte Audi sein Luxusmodell A8 vorgestellt, dessen Technik für Level drei vorbereitet war. Aber es dauerte bis 2022, ehe Mercedes mit dem Drive Pilot ein System in das Flaggschiff S-Klasse integrieren konnte, das das beherrscht. Letztendlich ist diese Technik ein automatischer Staupilot, der bei Stopp-and-Go-Verkehr und somit vergleichsweise überschaubaren Geschwindigkeiten das Steuer in die Hand nimmt. Tesla hat seinen sogenannten Autopiloten mittlerweile deutlich einbremsen müssen und auch die neuen Aushängeschilder Mercedes E-Klasse und BMW 5er / i5 beherrschen anders als von vielen erwartet kein Level drei. Für den Bayern gab es zumindest eine Ausnahmegenehmigung für Level 2+ ADAS in Deutschland zu verwenden. Heißt, ohne Hände am Steuer zieht der BMW 5er / i5 ohne zeitliche Begrenzung auf der Autobahn sicher seine Wege. Wer überholen will, schaut allein in den Außenspiegel und der Bayer wechselt die Spur. Dafür ist nicht einmal ein Lidar-Sensor erforderlich. 5G und das Full-Range-Frontradar mit einer Abtastleistung von 300 Metern sind der Schlüssel zur Erreichung dieser Funktion.

Das neue Mittelklassemodell Nio ET5 ist auf dem Dach und an der Front mit entsprechenden Sensoren ausgestattet. Nio will mit Tempo 120 ins Robo-Auto-Geschäft einsteigen. Mercedes tüftelt ebenfalls an der Geschwindigkeitserhöhung für seinen Drive Pilot. „Das automatisierte Fahren mit Level drei, bis maximal 120 Kilometer pro Stunde, stellt deutlich größere Herausforderungen für die ADAS-Systeme dar als das bei Tempo 60 der Fall ist“; sagt Dr. Jan Becker, CEO von Apex.Ai, der sich seit 24 Jahren mit Fahrassistenzsystemen und dem autonomen Fahren beschäftigt. Wie groß der Unterschied ist, zeigt ein einfaches Beispiel, das jeder aus der Fahrschule kennt. Bei der doppelten Geschwindigkeit vervierfacht sich der Bremsweg. Genau das müssen die Sensoren leisten und eine entsprechende Distanz zuverlässig abbilden. „Aktuell braucht man für das ADAS-Level drei eine Kombination aus Kameras, Radar- und Lidarsensoren. Lidar ist unter anderem deshalb nötig, weil die Auflösung, die Radar bietet, nicht ausreicht, aber vor allem, weil die Video-Radar-Kombination allein zu viele Failure Cases hat. Der Hauptgrund für die Kombination ist die notwendige Redundanz im Sensorset“, erklärt Jan Becker. An besseren Sensoren wird seit Jahren getüftelt. Mit Kameras allein endet der Versuch, ein selbstfahrendes Fahrzeug auf die Straße zu bringen, unweigerlich in einer Sackgasse. Das musste auch Tesla einsehen, die trotz aller ausgeklügelten Software jetzt wieder Radarsensoren in den Autos installieren.

Wie umfangreich diese Aufgabe ist, wird klar, wenn man die Arbeitsweise eines Radarsensors genauer betrachtet. Der Radarsensor sendet Mikrowellen aus, die hauptsächlich von metallischen Oberflächen reflektiert werden. Zum Beispiel von Autos, Gullydeckeln, Schilderbrücken über der Autobahn, Tunneleinfahrten und den Leitpfosten am Rand der Fahrbahn. Um autonom unterwegs zu sein, muss das System auszusortieren, was was ist. Bei stockendem Verkehrsfluss beziehungsweise bis 60 km/h ist das noch machbar, da man sich in der Regel an den anderen Autos orientieren kann und die Sensoren die Bremswegentfernung im Griff haben. Braust ein Pkw selbsttätig mit 120 km/h über die Autobahn und ein Auto steht zufällig genau in einer Tunneleinfahrt oder unter einer Schilderbrücke wird die Sache schon deutlich diffiziler. Dann muss die Bordelektronik fehlerfrei identifizieren, ob da ein Auto steht und gegebenenfalls bremsen.

Für die Software-Programmierer ist die Herausforderung ebenfalls immens. Was passiert, wenn ein Sensor Alarm schlägt und ein Hindernis meldet und ein anderer nicht? „Man benötigt Rechenmodelle, die abbilden, was ein Sensor leisten kann und was nicht. Daraus lässt sich dann ableiten, ob die Meldung des Sensors plausibel ist oder nicht“, weiß Jan Becker. Zum Beispiel ist ein Lidar-Sensor in der Regel recht tief eingebaut und kann nicht sehen, ob die Fahrzeuge vor dem Vordermann bremsen oder nicht, da der Pkw ihm die Sicht verstellt. Dagegen kann eine Kamera durch die Scheiben die aufleuchtenden roten Lichter des Verkehrs erkennen und auch die Radarsensoren können zu einem gewissen Grad unter einem vorausfahrenden Fahrzeug entlangschauen. Daher muss der Algorithmus diese Umstände bewerten und in die Entscheidung miteinbeziehen. Je schneller das Auto, desto größer die Herausforderung.

Keine Kommentare

Schreibe einen Kommentar